美国·旧金山时间6月13日,在Data Center and AI Technology Premiere上,AMD公布了将塑造计算未来的产品、战略和生态系统合作伙伴,重点介绍了下一阶段的数据中心创新。 AMD与来自AWS、Citadel、Hugging Face、Meta、Microsoft Azure和PyTorch等企业共同展示了最新合作成果,以将下一代高性能CPU和AI加速器解决方案推向市场。

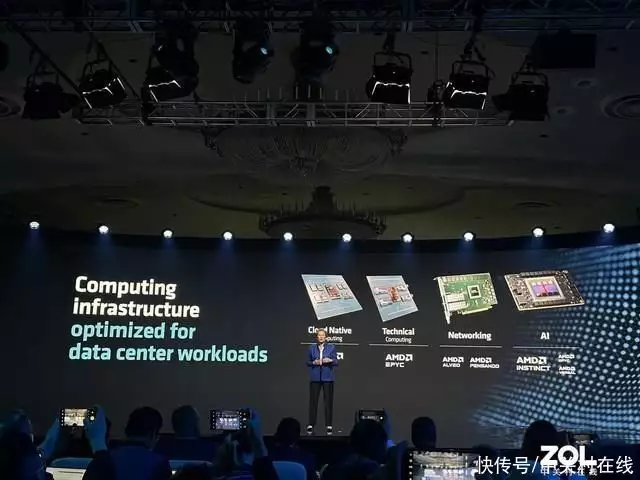

AMD公布面向云原生计算、技术计算、网络、AI的新战略

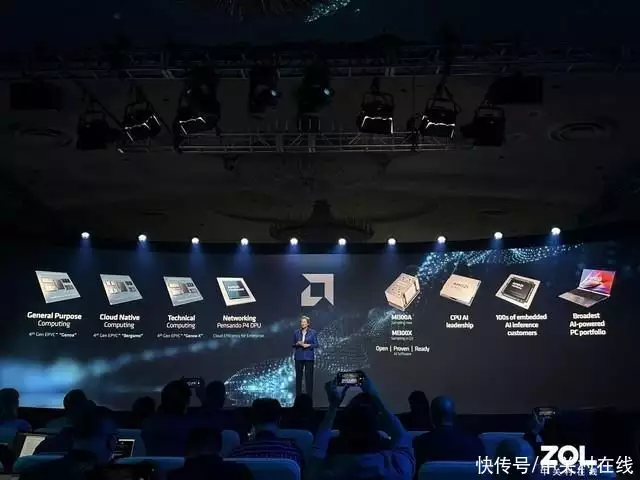

“今天,我们在数据中心战略上又向前迈出了重要一步,因为我们扩展了第四代EPYC处理器系列,为云计算和技术计算工作负载提供了全新的领先解决方案,并宣布了与最大云供应商的新公共实例和内部部署。”AMD董事长兼首席执行官Lisa Su博士表示,“人工智能是塑造下一代计算的决定性技术,也是AMD最大的战略增长机会。我们专注于加速AMD的AI平台在数据中心的大规模部署,计划于今年晚些时候推出我们的Instinct MI300加速器,并将持续壮大为我们的硬件优化的企业级AI软件生态系统。”

为现代数据中心优化的计算基础设施

AMD公布了其第四代EPYC系列的一系列更新,旨在为客户提供满足企业独特需求所需的专业工作负载。

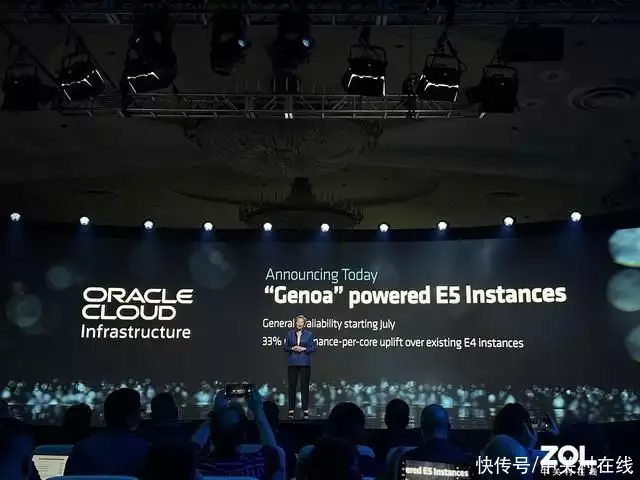

? 数据中心处理器。AMD重点介绍了第四代AMD EPYC处理器如何继续推动领先的性能和能效,包括由第四代 AMD EPYC处理器(“Genoa”)提供支持的下一代Amazon Elastic Compute Cloud (Amazon EC2) M7a实例的预览。此外,甲骨文宣布了计划提供配备第四代AMD EPYC处理器的全新甲骨文计算基础设施 (OCI) E5实例。

AMD与AWS发布最新实例

甲骨文计算基础设施的新实例

? 不妥协的云原生计算。AMD推出了代号为“Bergamo”的第四代AMD EPYC 97X4处理器,该处理器的每个插槽含有128个“Zen 4c”内核,为在云端运行的应用程序提供了最大的vCPU密度,以及领先的性能和能效。Meta与AMD展示了这些处理器的应用实践,包括Instagram、WhatsApp等。与第三代AMD EPYC处理器相比,Meta通过第四代AMD EPYC 97X4处理器获得了显著的性能提升,并且大幅改进了TCO,双方还讨论了利用EPYC处理器如何满足Meta的能效和计算-密度要求。

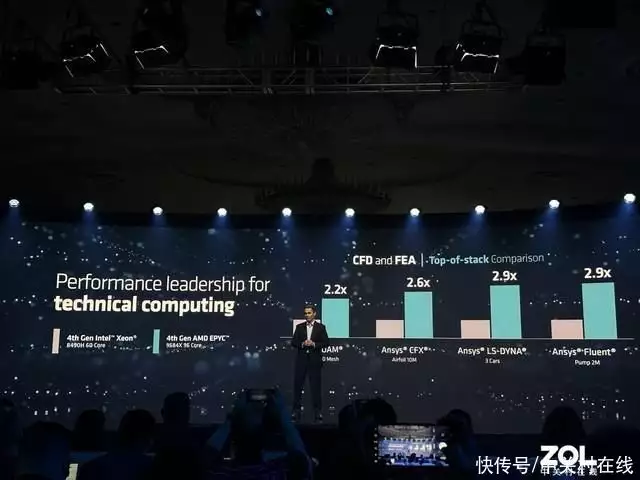

? 通过技术计算实现更好的产品。AMD推出了采用AMD 3D V-Cache技术的第四代AMD EPYC处理器,被视为性能最高的用于技术计算的x86服务器CPU之一。本次会议上,微软宣布全面推出Azure HBv4和HX实例,这些实例由采用AMD 3D V-Cache技术的第四代AMD EPYC处理器提供支持。

与intel第四代至强可扩展处理器的对比

微软推出Azure HBv4和HX实例

AMD人工智能平台——普适的人工智能愿景

AMD公布了一系列AI平台战略,为客户提供从云到边缘再到端点的硬件产品组合,通过深入的行业软件协作,开发可扩展且普及的AI解决方案。

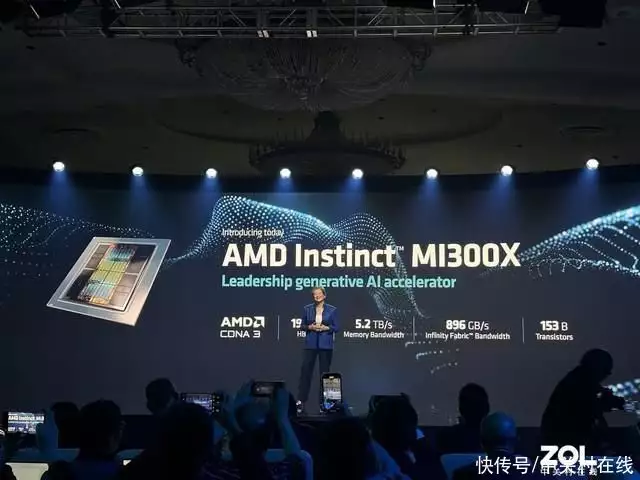

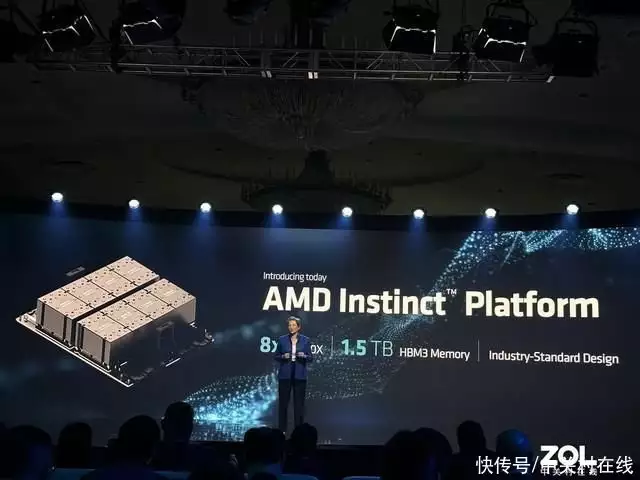

? 生成式AI加速器。 AMD介绍了AMD Instinct MI300系列加速器家族的新细节,包括推出AMD Instinct MI300X 加速器,MI300X基于下一代AMD CDNA 3架构,支持192 GB的HBM3内存,以提供大型语言模型、生成式AI等场景中的训练和推理所需计算和内存效率。借助AMD Instinct MI300X的大内存,客户现在可以在单个MI300X加速器上处理大型语言模型,例如Falcon-40B——一个400亿参数的模型。AMD还推出了AMD Instinct平台,该平台将八个MI300X加速器整合到一个行业标准设计中,为AI推理和训练提供完善的解决方案。MI300X将从第三季度开始向主要客户提供样品。AMD还宣布,全球首款用于HPC和AI工作负载的APU加速器AMD Instinct MI300A已向客户提供样品。

AMD Instinct MI300X

相较NVIDIA H100的密度和HBM带宽大幅提升

AMD Instinct Platform

? 将开放、成熟和就绪的人工智能软件平台推向市场。AMD介绍了用于数据中心加速器的ROCm软件生态系统,强调了与行业领导者的合作,以构建开放的AI软件生态系统。 PyTorch谈论了AMD和PyTorch基金会的协作,以支持上游ROCm软件堆栈,为所有AMD Instinct加速器上的ROCm 5.4.2版PyTorch 2.0提供即时的“零日”服务。 这种集成为开发人员提供了广泛的由PyTorch提供支持的AI模型,这些模型兼容并可以在AMD加速器上“开箱即用”。Hugging Face是面向AI构建者的开放平台,其宣布将在AMD平台上优化数千种Hugging Face模型,涵盖AMD Instinct加速器、AMD Ryzen和AMD EPYC处理器、AMD Radeon GPU,以及Versal和Alveo自适应处理器。

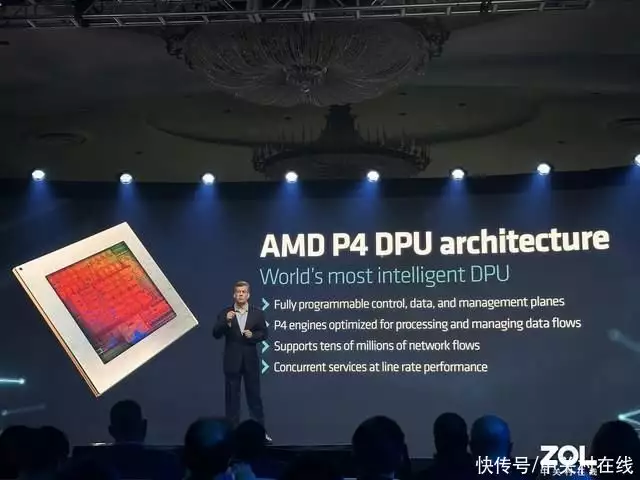

适用于云和企业的网络产品组合

AMD展示了网络产品组合,包括AMD Pensando DPU、AMD超低延迟网卡和AMD自适应网卡。 此外,AMD Pensando DPU将软件堆栈与“零信任安全”和可编程数据包处理器相结合,打造了智能、高性能的DPU。通过与IBM Cloud、Microsoft Azure和Oracle Compute Infrastructure等云合作伙伴的协作,AMD Pensando DPU已实现大规模部署。在企业中,AMD Pensando DPU可部署在HPE Aruba CX 10000智能交换机中,与IT服务公司DXC等客户建立了合作关系,并可作为VMware vSphere Distributed Services Engine的一部分,为客户加速应用程序的性能。

AMD P4 DPU架构

AMD Pensando DPU可部署在HPE Aruba CX 10000智能交换机

此外,AMD公布了代号为“Giglio”的下一代DPU路线图,与当前一代产品相比,该路线图旨在为客户带来更高的性能和能效,预计于2023年底上市。

AMD还发布了AMD Pensando Software-in-Silicon Developer Kit(SSDK),使客户能够快速开发或迁移服务,以便在AMD Pensando P4可编程DPU上部署,AMD Pensando SSDK可以帮助客户发挥AMD Pensando DPU在其基础架构中的网络虚拟化和安全功能,满足定制化的需求,并与Pensando平台上已有的丰富功能深度融合。

AMD在Data Center and AI Technology Premiere上的全线新品发布

(8213259)

相关标签: